Une étude suggère que la correction des « fausses informations » sur Twitter ne fonctionne pas de toute façon

Une nouvelle étude donne les détails.

Selon une nouvelle étude, le fait de corriger les fausses informations sur Twitter aggrave le problème, car cela entraîne une multiplication de ces mêmes informations.

L’étude a été menée par des chercheurs du MIT Sloan, aux États-Unis, et de l’université d’Exeter, au Royaume-Uni. Les chercheurs ont d’abord identifié environ 2 000 comptes Twitter de tous les horizons politiques qui avaient partagé l’un des 11 articles de fake news les plus populaires. Tous ces articles ont été démystifiés par Snopes, un site web qui se présente comme la « ressource définitive de vérification des faits ».

L’équipe a ensuite créé des comptes Twitter robots, qui existaient tous depuis plus de trois mois et avaient accumulé au moins 1 000 followers. Les comptes semblaient humains pour les autres utilisateurs de Twitter.

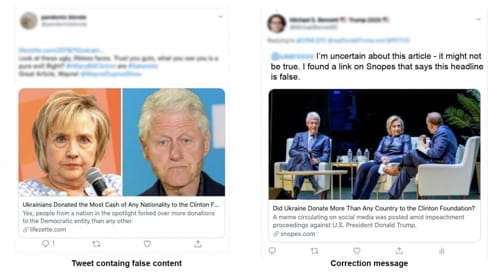

Les bots corrigeaient les tweets contenant l’un des 11 articles de fake news, en répondant par une déclaration du type : « J’ai des doutes sur cet article – il pourrait ne pas être vrai. J’ai trouvé un lien sur Snopes qui dit que ce titre est faux. » La réponse contenait également un lien vers l’information supposée correcte.

Les chercheurs ont constaté que la précision des retweets avait immédiatement diminué de 1 % dans les 24 heures suivant la correction. Ils ont également constaté que, dans les mêmes 24 heures, les utilisateurs corrigés avaient augmenté de plus de 1 % le « penchant partisan » de leurs tweets et de 3 % la « toxicité » du langage utilisé.

L’auteur principal de l’étude, le Dr Mohsen Mosleh, de l’école de commerce de l’université d’Exeter, a qualifié ces résultats de « peu encourageants », car ils suggèrent que l’un des outils de lutte contre la désinformation ne fonctionne pas.

« Après qu’un utilisateur a été corrigé, il a retweeté des informations dont la qualité était nettement inférieure et l’orientation partisane supérieure, et ses retweets contenaient davantage de langage toxique », a déclaré le Dr Mosleh.

Les chercheurs ont également constaté que la qualité des informations se dégradait dans les retweets (non cités ou accompagnés de commentaires), mais pas dans les tweets originaux ou « primaires » des comptes étudiés. Cela pourrait s’expliquer par le fait que les utilisateurs passent beaucoup plus de temps à élaborer des tweets originaux et beaucoup moins de temps à retweeter.

« Notre observation que l’effet ne se produit que sur les retweets suggère que l’effet opère par le canal de l’attention », a déclaré le co-auteur de l’étude, le professeur David Rand de la Sloan School of Management du MIT.

« Nous aurions pu nous attendre à ce que le fait d’être corrigé modifie l’attention portée à la précision.

Mais au lieu de cela, il semble que le fait d’être corrigé publiquement par un autre utilisateur a détourné l’attention des gens de l’exactitude – peut-être vers d’autres facteurs sociaux tels que l’embarras.

Cela montre à quel point la lutte contre la désinformation est compliquée, et il faut éviter d’encourager les gens à se corriger mutuellement en ligne. »

Lire aussi : Twitter et un « vérificateur de faits » ont fait de fausses déclarations sur le tireur du Colorado

Source : Reclaim The Net – Traduit par Anguille sous roche