Une IA prédit 90 % des crimes avant qu’ils ne se produisent, son créateur affirme qu’elle ne sera pas utilisée à mauvais escient

Les critiques restent sceptiques.

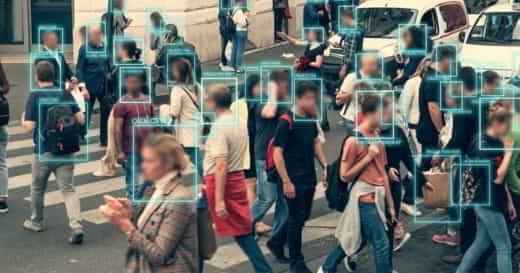

Une nouvelle IA conçue pour prédire la criminalité avant qu’elle ne se produise a été testée dans plusieurs villes américaines. Elle a prédit avec précision les événements dans 80 à 90 % des cas. L’IA est censée être conçue pour optimiser les politiques et allouer des ressources aux zones d’une ville qui en ont le plus besoin, mais les inquiétudes sont nombreuses quant aux mauvais résultats de l’IA et à ses biais inhérents.

Aujourd’hui, le créateur a accordé une interview à BBC Science Focus. Et il avait beaucoup à dire. Il a notamment expliqué pourquoi il pense que le déploiement de son IA serait une bonne chose.

Dans son dernier article, publié dans Nature Human Behaviour, le professeur Ishanu Chattopadhyay et ses collègues font la démonstration d’un modèle d’IA prédictif dans huit grandes villes américaines. Le concept est simple : La ville de Chicago publie des journaux d’événements pour chaque crime, y compris où et quand le crime a eu lieu, et ces données sont introduites dans un algorithme d’apprentissage automatique. Ensuite, la ville est divisée en tranches de 90 mètres carrés et les journaux d’événements sont combinés avec les zones pour créer ce que les chercheurs appellent une « série chronologique ». L’IA utilise ensuite ces séries chronologiques pour prédire les crimes en fonction du lieu et du moment où ils se produisent.

Essentiellement, le modèle peut dire « il y aura probablement un vol à main armée dans cette zone spécifique ce jour-là », mais pas qui le commettra. Cela la distingue des autres technologies utilisées pour détecter les crimes, comme l’IA dont nous avons parlé précédemment et qui identifie les personnes les plus susceptibles d’être des criminels (ce qui était, bien sûr, horriblement raciste et imparfait).

« Les gens craignent que cela soit utilisé comme un outil pour mettre les gens en prison avant qu’ils ne commettent des crimes. Cela ne se produira pas, car le système n’en a pas la capacité. Il ne fait que prédire un événement à un endroit précis », a déclaré M. Chattopadhyay à BBC Science Focus.

« Il ne vous dit pas qui va commettre l’événement ou la dynamique ou la mécanique exacte des événements. »

Cela amène l’une des questions les plus importantes sur le sujet – dans le thème de nombreuses autres IA prédictives sociales, ce modèle est-il la proie des biais racistes et socio-économiques paralysants que tant d’autres avant lui ont fait ?

Selon M. Chattopadhyay, la méthode utilisée pour former le modèle permet d’éviter ces préjugés, car il s’agit simplement de journaux d’événements qui lui sont fournis. Il y a très peu d’entrées manuelles, et c’est censé être une bonne chose.

« Nous avons essayé de réduire les biais autant que possible. C’est en cela que notre modèle est différent des autres modèles qui l’ont précédé », a-t-il ajouté.

Il reste maintenant à voir si les villes commenceront à utiliser un tel modèle pour élaborer des politiques, ou si elles s’en tiendront à l’écart en raison de ses antécédents sombres. Les chercheurs semblent confiants dans la capacité de leur IA à contourner ces problèmes, mais étant donné les possibilités d’abus de ces systèmes, beaucoup restent sceptiques.

Source : IFLScience – Traduit par Anguille sous roche