Les vidéos deepfake deviennent incroyablement bonnes

Un nouveau système de manipulation vidéo récemment révélé montre à quel point les fausses vidéos super-réalistes s’améliorent plus vite que certains d’entre nous le pensaient possible.

La conférence SIGGRAPH 2018 sur l’infographie et le design est prévue du 12 au 16 août à Vancouver, en Colombie-Britannique, mais nous avons déjà un avant-goût des technologies qui vont être exposées.

L’un de ces systèmes, baptisé Deep Video Portraits, montre à quel point les vidéos fake s’améliorent. La vidéo manipulée d’Obama de l’année dernière, développée à l’Université de Washington, était plutôt cool, mais elle n’impliquait que des expressions faciales, et c’était de toute évidence une imitation. L’exercice a servi de preuve de concept importante, mettant en évidence le potentiel effrayant des vidéos fake, très réalistes et générées par ordinateur. Eh bien, ce futur, comme le montre la nouvelle technologie Deep Video Portraits, est en train d’arriver ici assez rapidement.

Le nouveau système a été développé par Michael Zollhöfer, professeur assistant invité à l’Université de Stanford, et ses collègues de l’Université technique de Munich, de l’Université de Bath, de Technicolor et d’autres institutions. La nouvelle approche de Zollhöfer utilise la vidéo d’entrée pour créer des réanimations photoréalistes de vidéos de portraits. Ces vidéos d’entrée sont créées par un acteur source, dont les données sont utilisées pour manipuler le portrait vidéo d’un acteur cible. Ainsi, par exemple, n’importe qui peut servir d’acteur source et faire transférer ses expressions faciales sur une vidéo de Barack Obama ou Vladimir Poutine, par exemple.

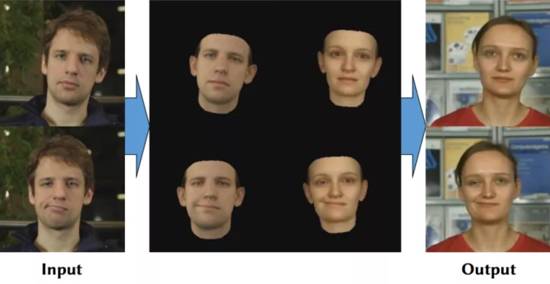

Le nouveau système permet “un contrôle total sur la cible en transférant la pose rigide de la tête, l’expression du visage et le mouvement des yeux avec un haut niveau de photoréalisme”. Ici, un acteur source (l’entrée/input) est utilisé pour manipuler une vidéo portrait d’un acteur cible (la sortie/outpu).

Image : H. Kim et al, 2018

Mais c’est plus que des expressions faciales. La nouvelle technique permet d’effectuer toute une série de mouvements, y compris les positions de la tête en 3D, la rotation de la tête, le regard et le clignement des yeux. Le nouveau système utilise l’IA sous la forme de réseaux neuronaux génératifs pour faire le tour, en prenant les données des modèles de signaux et en calculant, ou en prédisant, les trames photoréalistes pour l’acteur cible donné. De façon impressionnante, les animateurs n’ont pas besoin de modifier les graphiques pour les cheveux du corps existant, le corps de l’acteur cible ou l’arrière-plan.

Des algorithmes secondaires sont utilisés pour corriger les défauts et autres artefacts, ce qui donne aux vidéos un aspect super réaliste et lisse. Les résultats ne sont pas parfaits, mais ils sont impressionnants. L’article décrivant la technologie, en plus d’être accepté pour présentation au SIGGRAPH 2018, a été publié dans la revue scientifique à comité de lecture ACM Transactions on Graphics.

Deep Video Portraits présente maintenant une façon très efficace de faire de l’animation par ordinateur et d’acquérir des mouvements photoréalistes de performances d’acteur préexistantes. Le système, par exemple, pourrait être utilisé en doublage audio lors de la création de versions de films dans d’autres langues. Ainsi, si un film est tourné en anglais, cette technologie pourrait être utilisée pour modifier les mouvements des lèvres afin de faire correspondre le son doublé en français ou en espagnol, par exemple.

Malheureusement, ce système fera probablement l’objet d’abus – un problème qui n’est pas perdu pour les chercheurs.

“Par exemple, la combinaison de la synthèse photo-réelle d’images faciales avec un imitateur vocal ou un système de synthèse vocale, permettrait de générer du contenu vidéo inventé qui pourrait potentiellement être utilisé pour diffamer les gens ou pour diffuser des fake news”, écrit M. Zollhöfer sur son blog de Stanford. “Actuellement, les vidéos modifiées présentent encore de nombreux artefacts, ce qui rend la plupart des contrefaçons faciles à repérer. Il est difficile de prédire à quel moment de telles vidéos ‘fausses’ seront impossibles à distinguer du contenu réel pour nos yeux humains.”

Malheureusement, la technologie du deepfake est déjà utilisée dans le porno, et les premiers efforts pour réduire ou éliminer ces vidéos envahissantes s’avèrent en grande partie futiles. Mais pour le monde naissant des fake news, il existe des solutions potentielles, comme les algorithmes de filigrane. À l’avenir, l’IA pourrait être utilisée pour détecter les fake, reniflant des modèles qui sont invisibles à l’œil humain. En fin de compte, cependant, c’est à nous de distinguer les faits de la fiction.

“À mon avis, le plus important est que le grand public doit être conscient des capacités de la technologie moderne pour la génération et le montage vidéo”, écrit Zollhöfer. “Cela leur permettra de réfléchir de manière plus critique sur le contenu vidéo qu’ils consomment chaque jour, surtout s’il n’y a pas de preuve d’origine”.

[ACM Transactions on Graphics via BoingBoing]

Source : Gizmodo – Vidéos et images : H. Kim et al., 2018/Gizmodo